Optimiser les performances d’un serveur Nginx est une entreprise cruciale pour garantir une expérience utilisateur fluide et efficace. Nginx, en tant que serveur web hautement performant et léger, offre diverses stratégies et techniques d’optimisation. Explorons en détail les approches clés pour améliorer les performances de Nginx.

Tout d’abord, il est essentiel de comprendre que l’optimisation des performances peut se faire à plusieurs niveaux, notamment la configuration du serveur, la gestion du trafic, la mise en cache et la sécurisation du serveur. L’examen attentif de ces aspects permettra d’appréhender de manière holistique les méthodes visant à maximiser l’efficacité de Nginx.

-

Configuration du serveur Nginx :

La première étape consiste à examiner et ajuster la configuration du serveur Nginx. Ceci inclut le nombre de travailleurs (workers) et d’autres paramètres liés au matériel. L’optimisation des valeurs de ces paramètres peut augmenter la capacité du serveur à gérer simultanément un plus grand nombre de connexions.

nginxworker_processes auto; events { worker_connections 1024; }En utilisant la directive

worker_processes auto, Nginx ajustera automatiquement le nombre de processus en fonction du nombre de cœurs disponibles, assurant ainsi une utilisation optimale des ressources matérielles. -

Compression Gzip :

Activer la compression Gzip pour les données transférées entre le serveur et le client peut considérablement réduire la taille des fichiers et améliorer ainsi les temps de chargement des pages.

nginxgzip on; gzip_types text/plain text/css application/json application/javascript text/xml application/xml application/xml+rss text/javascript;En définissant les types de fichiers à compresser, on s’assure que la compression Gzip est appliquée de manière sélective pour maximiser l’efficacité.

-

Mise en cache :

La mise en cache est une stratégie clé pour réduire la charge du serveur en stockant temporairement les fichiers statiques et les résultats de requêtes fréquemment utilisés. Cela permet de servir ces ressources sans avoir besoin de générer dynamiquement le contenu à chaque requête.

nginxlocation ~* \.(jpg|jpeg|png|gif|ico|css|js)$ { expires 1y; add_header Cache-Control "public, no-transform"; }Cette configuration permet de définir des durées d’expiration pour certains types de fichiers, spécifiant ainsi combien de temps les navigateurs et les proxies peuvent conserver ces ressources en cache.

-

Load Balancing :

Nginx excelle également dans la répartition de charge (load balancing), une technique où le trafic est distribué entre plusieurs serveurs pour garantir une utilisation équilibrée des ressources.

nginxupstream backend { server backend1.example.com; server backend2.example.com; server backend3.example.com; } server { location / { proxy_pass http://backend; } }En configurant un groupe de serveurs backend et en utilisant la directive

proxy_pass, Nginx peut répartir la charge entre ces serveurs, améliorant ainsi la disponibilité et les performances globales du système. -

Sécurisation avec TLS/SSL :

Bien que cela puisse ne pas sembler directement lié aux performances, l’utilisation de TLS/SSL pour sécuriser les connexions peut améliorer l’expérience utilisateur en établissant une communication sécurisée entre le serveur et le client.

nginxserver { listen 443 ssl; server_name example.com; ssl_certificate /path/to/certificate.crt; ssl_certificate_key /path/to/privatekey.key; # Autres paramètres de configuration SSL }L’intégration du support SSL/TLS nécessite des certificats appropriés, mais cela renforce la sécurité des échanges de données, ce qui peut avoir un impact positif sur la confiance des utilisateurs et, par conséquent, sur l’engagement.

-

Surveillance et ajustements dynamiques :

La surveillance continue des performances du serveur Nginx est indispensable. Des outils tels que Munin, Nagios ou simplement les journaux Nginx peuvent fournir des informations précieuses sur les tendances de trafic, les erreurs et d’autres métriques clés.

En utilisant ces informations, il est possible d’ajuster dynamiquement la configuration du serveur, d’optimiser les ressources et de résoudre rapidement les problèmes potentiels.

En conclusion, l’optimisation des performances d’un serveur Nginx nécessite une approche holistique, couvrant divers aspects tels que la configuration du serveur, la compression, la mise en cache, la répartition de charge et la sécurisation. En adoptant ces bonnes pratiques, il est possible d’assurer une expérience utilisateur optimale, même dans des environnements à forte demande.

Plus de connaissances

Continuons notre exploration des différentes stratégies et techniques pour optimiser les performances du serveur Nginx, en approfondissant davantage les aspects liés à la configuration avancée, à la gestion des connexions, à la surveillance continue, et à l’ajustement dynamique du serveur.

-

Configuration avancée du serveur Nginx :

Pour des performances optimales, il est crucial d’ajuster finement la configuration du serveur en fonction des besoins spécifiques de votre application. Par exemple, la directive

sendfilepeut être activée pour améliorer l’efficacité de la transmission des fichiers statiques.nginxsendfile on; tcp_nopush on; tcp_nodelay on;En activant

sendfile, Nginx peut utiliser le mécanisme de transmission des fichiers du système d’exploitation, améliorant ainsi l’efficacité du transfert de fichiers statiques.Les directives

tcp_nopushettcp_nodelaypermettent respectivement d’améliorer l’envoi de fichiers en minimisant le nombre de paquets réseau et en désactivant le délai de transmission. -

Gestion des connexions :

Une gestion efficace des connexions est essentielle pour éviter les goulets d’étranglement et garantir une distribution optimale des ressources. La directive

keepalive_timeoutdéfinit la durée pendant laquelle une connexion keep-alive peut rester ouverte.nginxkeepalive_timeout 65;En ajustant cette valeur en fonction du comportement de trafic spécifique, vous pouvez éviter l’ouverture et la fermeture fréquentes de connexions, améliorant ainsi les performances.

De plus, la directive

client_max_body_sizepermet de limiter la taille des requêtes client, prévenant ainsi les attaques potentielles par déni de service en limitant la quantité de données pouvant être envoyée dans une seule requête.nginxclient_max_body_size 20M; -

Optimisation de PHP-FPM :

Si Nginx est utilisé comme proxy inverse avec PHP-FPM, il est crucial d’optimiser également la configuration de PHP-FPM. La coordination entre Nginx et PHP-FPM peut être améliorée en ajustant des paramètres tels que

pm.max_children,pm.start_servers, etpm.min_spare_servers.nginxlocation ~ \.php$ { include snippets/fastcgi-php.conf; fastcgi_pass unix:/run/php/php7.4-fpm.sock; fastcgi_param SCRIPT_FILENAME $document_root$fastcgi_script_name; include fastcgi_params; }En optimisant ces paramètres, on s’assure que PHP-FPM alloue efficacement les ressources nécessaires pour gérer le trafic PHP.

-

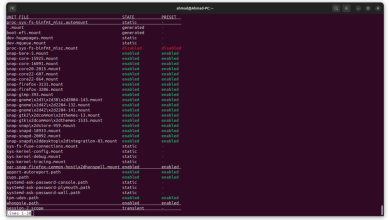

Surveillance continue avec des outils dédiés :

L’utilisation d’outils de surveillance tels que Prometheus, Grafana ou même les modules de surveillance intégrés à Nginx permet de collecter et d’analyser des métriques en temps réel. Ces métriques incluent le taux de requêtes, la charge du serveur, la disponibilité des connexions, et bien d’autres.

L’intégration d’un système de surveillance permet une réaction proactive aux problèmes potentiels, réduisant ainsi les temps d’arrêt et améliorant la stabilité du serveur.

nginxlocation /nginx_status { stub_status on; access_log off; allow 127.0.0.1; deny all; }En activant le module de statut Nginx, vous pouvez exposer une page de statut qui peut être utilisée par des outils de surveillance pour collecter des informations cruciales.

-

Ajustements dynamiques avec Nginx Plus :

Nginx Plus, la version commerciale de Nginx, offre des fonctionnalités avancées telles que la gestion dynamique de la configuration et la répartition de charge basée sur des facteurs tels que la charge du serveur, la disponibilité des ressources, et les performances.

nginxupstream backend { least_conn; server backend1.example.com; server backend2.example.com; server backend3.example.com; } server { location / { proxy_pass http://backend; } }En utilisant la directive

least_conn, Nginx Plus peut distribuer la charge de manière plus intelligente en tenant compte de la charge actuelle de chaque serveur backend. -

Optimisation du cache Nginx :

Outre la mise en cache côté client, Nginx propose également des mécanismes de mise en cache côté serveur. La directive

proxy_cachepermet de définir un espace de stockage pour les fichiers mis en cache, tandis queproxy_cache_validspécifie la durée de validité des éléments mis en cache.nginxlocation / { proxy_pass http://backend; proxy_cache my_cache; proxy_cache_valid 200 302 10m; proxy_cache_valid 404 1m; }En utilisant ces directives, Nginx peut stocker en mémoire les réponses aux requêtes fréquentes, réduisant ainsi la charge sur le backend et améliorant les temps de réponse.

En conclusion, l’optimisation des performances de Nginx nécessite une approche détaillée et la compréhension approfondie des besoins spécifiques de votre application. En combinant une configuration fine du serveur, une gestion intelligente des connexions, une surveillance continue et l’utilisation d’outils avancés, il est possible de créer un environnement Nginx hautement performant, garantissant une expérience utilisateur optimale.