Bien sûr, je serais ravi de vous fournir un guide complet sur l’analyse de la complexité des algorithmes. L’analyse de la complexité des algorithmes est un domaine crucial en informatique qui vise à évaluer les ressources nécessaires, telles que le temps et l’espace, pour exécuter un algorithme donné. Cela nous aide à comprendre comment les algorithmes se comportent lorsque la taille des données d’entrée augmente, ce qui est essentiel pour concevoir des solutions efficaces et éviter les goulots d’étranglement.

Introduction à l’analyse de la complexité des algorithmes

L’analyse de la complexité des algorithmes peut être divisée en deux grandes catégories : l’analyse du temps et l’analyse de l’espace. L’analyse du temps examine combien de temps un algorithme prend pour s’exécuter en fonction de la taille de l’entrée, tandis que l’analyse de l’espace examine combien de mémoire un algorithme utilise en fonction de la taille de l’entrée.

La solution définitive pour raccourcir les liens et gérer vos campagnes digitales de manière professionnelle.

• Raccourcissement instantané et rapide des liens

• Pages de profil interactives

• Codes QR professionnels

• Analyses détaillées de vos performances digitales

• Et bien plus de fonctionnalités gratuites !

Analyse du temps

Notations de complexité

Pour analyser la complexité temporelle, nous utilisons généralement la notation « O grand » (notation de Landau), qui décrit le comportement asymptotique d’une fonction lorsque la taille de l’entrée devient très grande. Par exemple, O(n) représente une complexité linéaire, ce qui signifie que le temps d’exécution de l’algorithme croît linéairement avec la taille de l’entrée. De même, O(n²) représente une complexité quadratique, O(log n) une complexité logarithmique, etc.

Techniques d’analyse

Il existe plusieurs techniques pour analyser la complexité temporelle des algorithmes, notamment :

-

Analyse en temps constant : Certains algorithmes ont un temps d’exécution constant, indépendamment de la taille de l’entrée. Par exemple, l’accès à un élément dans un tableau par son indice a une complexité O(1).

-

Analyse en temps linéaire : De nombreux algorithmes ont une complexité linéaire, ce qui signifie que leur temps d’exécution croît de manière linéaire avec la taille de l’entrée. Par exemple, parcourir une liste ou un tableau a une complexité O(n).

-

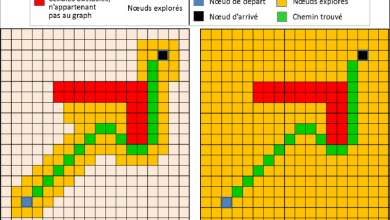

Analyse en temps logarithmique : Certains algorithmes, tels que la recherche binaire, ont une complexité logarithmique, ce qui signifie que leur temps d’exécution croît de manière logarithmique avec la taille de l’entrée. Par exemple, la recherche binaire a une complexité O(log n).

-

Analyse en temps quadratique : Certains algorithmes ont une complexité quadratique, ce qui signifie que leur temps d’exécution croît quadratiquement avec la taille de l’entrée. Par exemple, certains algorithmes de tri comme le tri par sélection ont une complexité O(n²).

-

Analyse en temps exponentiel : Certains algorithmes, comme la résolution brute de certains problèmes NP-complets, ont une complexité exponentielle, ce qui signifie que leur temps d’exécution augmente de manière exponentielle avec la taille de l’entrée. Par exemple, certains problèmes de voyageur de commerce peuvent être résolus de manière exacte en utilisant des algorithmes exponentiels.

Analyse de l’espace

L’analyse de la complexité de l’espace examine la quantité de mémoire requise par un algorithme en fonction de la taille de l’entrée. Comme pour l’analyse du temps, nous utilisons la notation « O grand » pour décrire la complexité de l’espace. Par exemple, O(n) signifie que l’algorithme utilise un espace proportionnel à la taille de l’entrée.

Conclusion

En conclusion, l’analyse de la complexité des algorithmes est un aspect crucial de la conception d’algorithmes efficaces. En comprenant comment les algorithmes se comportent en termes de temps et d’espace, les développeurs peuvent choisir les meilleures solutions pour résoudre un problème donné tout en tenant compte des contraintes de performance. En utilisant des techniques d’analyse appropriées telles que la notation « O grand » et différentes techniques d’analyse, les développeurs peuvent évaluer et comparer les performances des algorithmes et choisir la meilleure solution pour leurs besoins.

Plus de connaissances

Bien sûr, approfondissons davantage les concepts et techniques liés à l’analyse de la complexité des algorithmes.

Analyse du temps

Notations de complexité

Outre la notation « O grand », il existe d’autres notations utilisées pour décrire la complexité temporelle des algorithmes :

-

Notation Ω (Omega) : Cette notation décrit le meilleur cas de temps d’exécution d’un algorithme. Par exemple, si un algorithme de tri a une complexité Ω(n), cela signifie que dans le meilleur des cas, il effectue n opérations.

-

Notation Θ (Thêta) : Cette notation décrit le cas moyen ou en moyenne du temps d’exécution d’un algorithme. Si un algorithme a une complexité Θ(n), cela signifie que son temps d’exécution est proportionnel à n dans le pire et le meilleur cas.

Analyse amortie

Parfois, l’analyse de la complexité temporelle nécessite une approche différente, notamment pour les structures de données dynamiques telles que les tableaux dynamiques (ou vecteurs). Dans ces cas, l’analyse amortie est utilisée pour déterminer la complexité temporelle moyenne par opération sur une séquence d’opérations.

Analyse de l’espace

Outre la notation « O grand », il existe des notations similaires pour décrire la complexité spatiale des algorithmes, telles que Ω et Θ.

Mémoire supplémentaire

L’analyse de la complexité spatiale prend également en compte la mémoire supplémentaire utilisée par un algorithme en dehors de celle nécessaire pour stocker l’entrée et la sortie. Cela peut inclure la mémoire pour les variables temporaires, les structures de données auxiliaires, etc.

Meilleures pratiques et optimisation

L’analyse de la complexité des algorithmes est fondamentale pour concevoir des systèmes efficaces, mais ce n’est pas la seule considération. D’autres facteurs tels que la lisibilité du code, la maintenance, la simplicité algorithmique et les optimisations matérielles doivent également être pris en compte lors de la conception d’algorithmes et de structures de données.

Techniques d’optimisation

-

Optimisation itérative vs récursive : Dans certains cas, la récursivité peut conduire à une complexité exponentielle, tandis que l’approche itérative peut réduire la complexité à linéaire ou même constante.

-

Éviter les redondances : Identifier et éliminer les redondances dans le code peut souvent réduire la complexité temporelle et spatiale.

-

Utilisation de structures de données efficaces : Choisir les bonnes structures de données en fonction des opérations effectuées peut grandement améliorer les performances. Par exemple, utiliser un arbre binaire équilibré au lieu d’une liste chaînée pour le stockage d’éléments peut réduire la complexité de certaines opérations de O(n) à O(log n).

Conclusion

En somme, l’analyse de la complexité des algorithmes est un sujet vaste et crucial en informatique. Elle nécessite une compréhension approfondie des structures de données, des techniques algorithmiques et des notations de complexité. En maîtrisant ces concepts, les développeurs peuvent concevoir des systèmes informatiques performants, évolutifs et efficaces, capables de gérer des volumes de données croissants et des charges de travail variées.