L’exploration des problèmes liés aux protocoles dans les réseaux informatiques est une entreprise complexe et cruciale pour assurer le bon fonctionnement, la sécurité et l’efficacité des communications au sein de ces réseaux. Les protocoles, définis comme des règles et des conventions établissant la manière dont les données sont échangées entre les dispositifs connectés, jouent un rôle central dans la connectivité moderne. Dans cette perspective, l’analyse des enjeux liés à ces protocoles se révèle être un domaine de recherche et de compréhension fondamental.

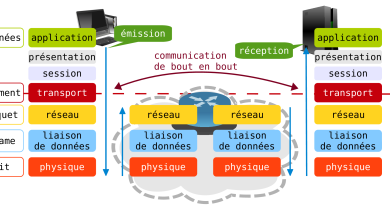

Les problèmes potentiels peuvent émerger à différents niveaux des protocoles, qu’il s’agisse de la couche physique, de la couche liaison de données, de la couche réseau, de la couche transport ou de la couche application du modèle OSI (Open Systems Interconnection). À la base, la couche physique concerne les aspects matériels de la transmission de données, incluant les câbles, les connecteurs et les signaux électriques. Des problèmes à ce niveau peuvent résulter de défaillances matérielles, d’interférences électromagnétiques ou de perturbations externes, impactant ainsi la qualité de la communication.

La couche liaison de données, quant à elle, assure un transfert de données sans erreur entre les nœuds reliés directement. Les problèmes potentiels dans cette couche incluent les collisions, les erreurs de trame et les problèmes liés aux protocoles d’accès au médium, tels que CSMA/CD (Carrier Sense Multiple Access with Collision Detection) dans le cas des réseaux Ethernet. Ces problèmes peuvent entraîner des retards, des pertes de données et des inefficiences dans la transmission.

Au niveau de la couche réseau, qui se charge du routage des données à travers le réseau, des problèmes peuvent surgir liés à la congestion, aux boucles dans les topologies de réseau, aux attaques de type déni de service (DoS) ou aux erreurs de configuration des routeurs. L’identification rapide et la résolution de ces problèmes sont cruciales pour maintenir des performances optimales et garantir une connectivité fiable.

La couche transport gère le transport de données de bout en bout entre les applications. Des problèmes dans cette couche peuvent inclure des erreurs de contrôle de flux, des pertes de paquets ou des problèmes de congestion. Ces problèmes peuvent impacter directement les applications en provoquant des retards, des interruptions de service ou des dégradations de la qualité.

Enfin, la couche application englobe les protocoles spécifiques aux applications utilisées par les utilisateurs finaux. Les problèmes dans cette couche peuvent résulter de bogues logiciels, de vulnérabilités de sécurité ou d’incompatibilités entre les différentes applications. Ces problèmes peuvent affecter la convivialité, la stabilité et la sécurité des applications déployées dans le réseau.

Pour détecter et résoudre ces problèmes, divers outils et techniques sont utilisés. Les outils de surveillance réseau, tels que les analyseurs de paquets, permettent d’inspecter le trafic en temps réel pour identifier les anomalies. Les protocoles de gestion réseau, comme SNMP (Simple Network Management Protocol), offrent des moyens de collecter des informations sur l’état du réseau et de déclencher des actions en cas de problème. De plus, les systèmes de détection d’intrusion (IDS) peuvent être déployés pour identifier les comportements malveillants ou anormaux.

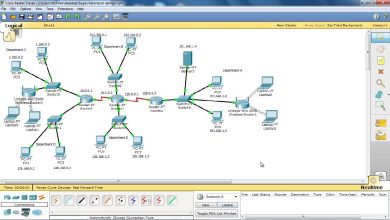

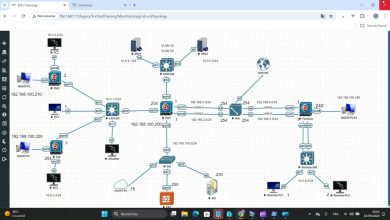

Les laboratoires de test et les simulations sont également des outils essentiels pour évaluer les performances des protocoles dans des conditions contrôlées. Ces méthodes permettent de reproduire des scénarios spécifiques, de mesurer les performances et d’identifier les éventuels problèmes. La collaboration entre chercheurs, ingénieurs et experts en sécurité réseau est cruciale pour faire progresser notre compréhension des protocoles et pour développer des solutions innovantes face aux défis émergents.

Par ailleurs, la normalisation joue un rôle essentiel dans le domaine des protocoles réseau. Les organismes tels que l’Internet Engineering Task Force (IETF) définissent les spécifications techniques et les standards qui guident le développement et la mise en œuvre des protocoles. Cette normalisation favorise l’interopérabilité entre les équipements de différents fabricants, contribuant ainsi à la cohérence et à la stabilité des réseaux.

Il est également important de souligner que la sécurité des protocoles est une préoccupation majeure. Les attaques informatiques, telles que l’usurpation d’identité, le détournement de sessions ou les attaques par déni de service distribué (DDoS), représentent des menaces constantes pour la stabilité des réseaux. Les mécanismes de sécurité, tels que le chiffrement, les pare-feu et les protocoles d’authentification, sont intégrés aux protocoles pour renforcer la résilience du réseau face à ces menaces.

En conclusion, l’exploration des problèmes liés aux protocoles dans les réseaux informatiques nécessite une approche holistique, couvrant les différentes couches du modèle OSI. Les défis associés à la détection, à la prévention et à la résolution de ces problèmes exigent une collaboration étroite entre les acteurs de l’industrie, les chercheurs et les experts en sécurité réseau. En continuant à investir dans la recherche, la normalisation et le développement d’outils innovants, nous pouvons renforcer la robustesse et la fiabilité des protocoles, assurant ainsi des communications fluides et sécurisées au sein des réseaux informatiques modernes.

Plus de connaissances

Poursuivons notre exploration approfondie des problèmes liés aux protocoles dans les réseaux informatiques en examinant de plus près certaines des problématiques spécifiques rencontrées à chaque niveau du modèle OSI.

À la couche physique, où les données sont converties en signaux physiques pour la transmission, les problèmes peuvent résulter de divers facteurs. Les interférences électromagnétiques provenant d’équipements électriques adjacents peuvent perturber les signaux, entraînant des erreurs de transmission. Les câbles défectueux ou mal connectés peuvent également causer des problèmes, affectant la qualité du signal et la fiabilité de la communication. La gestion de ces problèmes nécessite des techniques de détection des erreurs, telles que la parité ou les codes de détection d’erreurs plus avancés.

Dans la couche liaison de données, où les trames de données sont encadrées pour une transmission sans erreur, des collisions peuvent survenir dans les réseaux partagés. Les collisions se produisent lorsque deux dispositifs tentent de transmettre des données simultanément sur le même support physique. Des protocoles tels que CSMA/CD sont conçus pour gérer ces situations en détectant les collisions et en organisant une retransmission différée. Cependant, une mauvaise gestion des collisions peut entraîner des performances médiocres et des pertes de données.

La couche réseau est confrontée à des problèmes de routage, de commutation et de gestion du trafic. Les boucles dans les topologies de réseau peuvent entraîner une circulation infinie des paquets, impactant la performance du réseau. Les protocoles de routage défectueux ou mal configurés peuvent conduire à des chemins inefficaces, augmentant le temps de latence. De plus, la congestion peut survenir lorsque la capacité du réseau est dépassée, provoquant des retards dans la transmission des données. Des mécanismes de contrôle de congestion, tels que TCP (Transmission Control Protocol), sont essentiels pour atténuer ces problèmes.

La couche transport gère le transport fiable de données de bout en bout entre les applications. Les problèmes tels que la perte de paquets, la duplication, la réorganisation incorrecte ou la congestion peuvent survenir. Des mécanismes tels que le contrôle de flux, la correction d’erreurs et la gestion de la congestion sont mis en œuvre pour garantir une transmission fiable et efficace des données. Les attaques de type DDoS peuvent également cibler la couche transport pour perturber les communications, mettant en lumière l’importance des mécanismes de sécurité.

En ce qui concerne la couche application, des défis spécifiques se posent en termes de compatibilité et de sécurité des protocoles. Des applications utilisant des protocoles différents peuvent rencontrer des difficultés d’interopérabilité, nécessitant parfois des passerelles ou des protocoles de traduction. La sécurité des applications est une préoccupation majeure, car les protocoles d’application peuvent être vulnérables à des attaques telles que l’injection de code, les attaques de session, ou les fuites d’informations sensibles. La mise en œuvre de mécanismes de chiffrement, d’authentification robuste et de bonnes pratiques de développement logiciel est cruciale pour renforcer la sécurité des applications.

Concernant les outils et techniques utilisés pour résoudre ces problèmes, il convient de mentionner l’importance croissante de l’intelligence artificielle (IA) et de l’apprentissage automatique. Ces technologies sont de plus en plus utilisées pour l’analyse prédictive des performances réseau, la détection d’anomalies et la réponse automatique aux incidents. Les algorithmes d’apprentissage automatique peuvent identifier des schémas complexes dans les données de trafic, permettant une détection précoce des problèmes potentiels et une prise de décision rapide.

En ce qui concerne la normalisation, l’IETF continue de jouer un rôle central dans le développement et la maintenance des protocoles Internet. Des groupes de travail au sein de l’IETF se consacrent à l’amélioration des protocoles existants, au développement de nouvelles normes et à la résolution des problèmes émergents. L’évolution constante des protocoles pour répondre aux besoins changeants des réseaux modernes est essentielle pour garantir une connectivité robuste et sécurisée.

En conclusion, l’exploration des problèmes liés aux protocoles dans les réseaux informatiques nécessite une approche détaillée à chaque niveau du modèle OSI. La résolution de ces problèmes exige une combinaison de techniques allant de la détection des erreurs physiques à la gestion de la congestion et à la sécurisation des applications. L’adoption de technologies émergentes telles que l’IA contribue à renforcer la capacité des réseaux à faire face à des problèmes complexes et à évoluer en réponse aux défis futurs. La collaboration continue entre les acteurs de l’industrie, les chercheurs et les organismes de normalisation est essentielle pour maintenir la fiabilité et la sécurité des réseaux informatiques à l’ère de la connectivité numérique.